Na YouTube sú falošné videá. Neklikajte na odkazy pod nimi

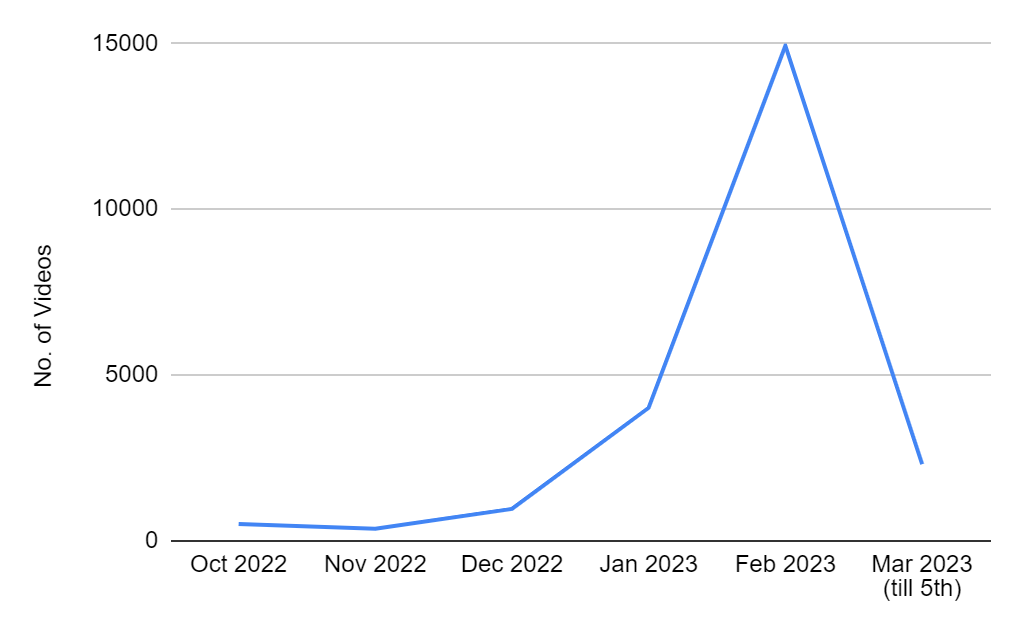

Platforma zažíva od minulého roka prudký nárast počtu videí, ktoré majú poškodiť používateľa.

Nie že by išlo priamo o infikované video alebo video, ktoré po prehratí spôsobí používateľovi nejaký problém. Cieľom takéhoto obsahu je priniesť v popise lákavú informáciu, ako získať cracknuté verzie softvéru zadarmo. Portál CloudSEK hovorí, že svoj podiel má na tom umelá inteligencia.

Ako to funguje?

Od novembra roku 2022 bolo zaznamenaný medzimesačný nárast o 200 až 300 percent počtu videí na YouTube. Je to platforma, ktorú používa 2,5 mil. ľudí a je preto celkom jasným cieľom podvodníkov a zvýšenia šance, že sa na ich podvod chytí veľká skupina ľudí. Umelá inteligencia hrá v tomto dôležitou úlohu, a to najmä s cieľom oklamať používateľov a vytvoriť kópiu dôveryhodného videa. Bežne sa totiž stretávate s videami, na ktorých svoje produkty alebo rôzne služby propagujú známi ľudia a preto máme týmto videám tendenciu dôverovať.

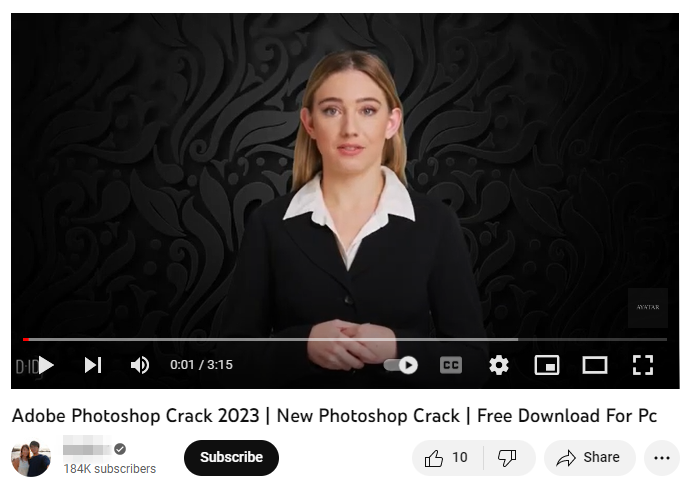

Umelá inteligencia prostredníctvom nástrojov Synthesia a D-ID vytvára generované videá, ktoré majú za cieľ napodobniť známe osobnosti propagujúce falošný produkt alebo nejakú službu a vytvoriť dojem, že toto video je dôveryhodné a je vytvorené známou osobou. Už letmý pohľad na toto video. Stačí, aby ste pochopili že s videom po obsahovej stránke ale aj po stránke prejavu nebude všetko v poriadku.

Diskutabilná kvalita AI

S týmito videami sme sa stretli takmer pred rokom, kedy sa šírili prostredníctvom kanálov na sociálnych sieťach. A propagovali rôzne teleshopingové ponuky, nové výhry alebo rôzne súťaže s možnosťou vyplnenia údajov, samozrejme na podozrivých stránkach, ktoré sa tvárili ako legitímne a sú napojené na propagované video.

Rovnako sa objavili v minulosti videá napodobňujúce svetových prezidentov alebo rôznych politikov či hercov a iné známe osobnosti. Vždy sa vyjadrovali k určitej politickej alebo exponovanej téme. V tomto smere je dobrou správou, že umelá inteligencia sa snaží hlasovou syntézou a spracovaním výrazu tváre napodobniť aj slovensky znejúci obsah.

Cieľ hrozieb

Obsah vytvorený umelou inteligenciou s dôrazom na vytvorenie falošnej slovenčiny je ešte stále rozpoznateľný (to je tá dobrá správa) a obsahuje mnohé gramatické, prípadne štylistické nekonzistencie. Dôležitý je v tomto prípade ani nie tak prejav, ale popis nachádzajúci sa pod videom. Je to bežná súčasť každého videa a hľadáme tam ďalšie informácie. Preto aj odkazovanie na ďalšie produkty alebo stránky či iné podrobnosti nepovažujeme za rizikové, ale priamo ich pod nami sledovanými videami hľadáme.

A práve tu cielia útočníci na dôveryhodnosť používateľov. Popisy obsahujú hypertextové odkazy smerujúce na malvér typu „stealer“ ako Vidar, RedLine a Raccoon. Útočníci chcú zamaskovať pôvod odkazov a tak využívajú internetové skracovače, aby neprezradili svoju svoj pôvodný odkaz. Takto to nebude podozrivé vyhľadávačom ani používateľom. Najčastejšie išlo o ponúkanie programov ako sú Photoshop, Premiere Pro, Autodesk 3ds Max alebo AutoCAD.

Škodlivé aplikácie, ktoré sa snažia vyhnúť detekcii antivírusových programov, musia byť v častých prípadoch modifikované. Preto aj útočníci menia tieto programy tak, aby zachovali ich utajenie pri programoch na odhaľovanie hrozieb, tu konkrétne typu stealer.

Podobné články

YouTube bez Premium: S Tubular si videá pozriete bez otravnej reklamy

YouTube Music bude v tomto lepší ako Spotify

YouTube testuje super funkciu na vyhľadávanie videí

YouTube pre Android opraví nepríjemnú funkciu

Android Auto a YouTube? S touto aplikáciou to nebude problém

YouTube testuje nové rozhranie, ktoré sa nebude páčiť každému